【大数据实训】—Hadoop开发环境搭建(一)-程序员宅基地

【大数据实训】—Hadoop开发环境搭建(一)

第一关、任务描述

本关任务:配置JavaJDK。

相关知识

配置开发环境是我们学习一门IT技术的第一步,Hadoop是基于Java开发的,所以我们学习Hadoop之前需要在Linux系统中配置Java的开发环境。

下载JDK

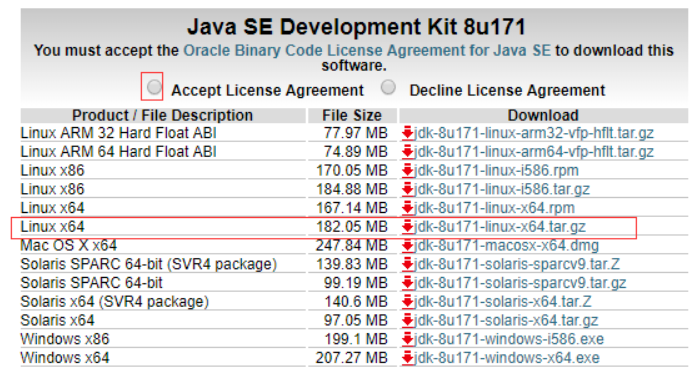

前往Oracle的官网下载JDK:点我前往Oracle的官网下载JDK

我们可以先下载到本地,然后从Windows中将文件传入到虚拟机中。

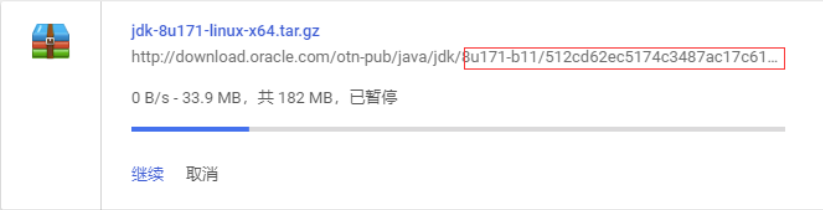

也可以复制链接地址,在Linux系统中下载,不过复制链接地址不能直接下载,因为Oracle做了限制,地址后缀需要加上它随机生成的随机码,才能下载到资源。

所以我们可以点击下载,然后暂停,最后在下载管理中复制链接地址就可以在Linux系统中下载啦。

因为JDK的压缩包有大概200M,所以我们已经在平台中为你下载好了JDK,不用你再去Oracle的官网去下载了,如果你要在自己的Linux系统中安装,那么还是需要下载的。

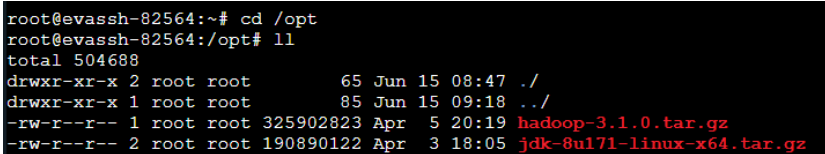

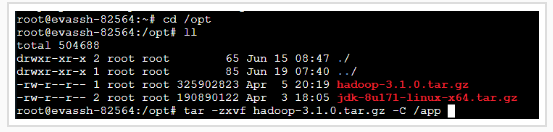

我们已经将JDK的压缩包放在系统的/opt目录下了,在命令行中切换至该目录下即可。

解压

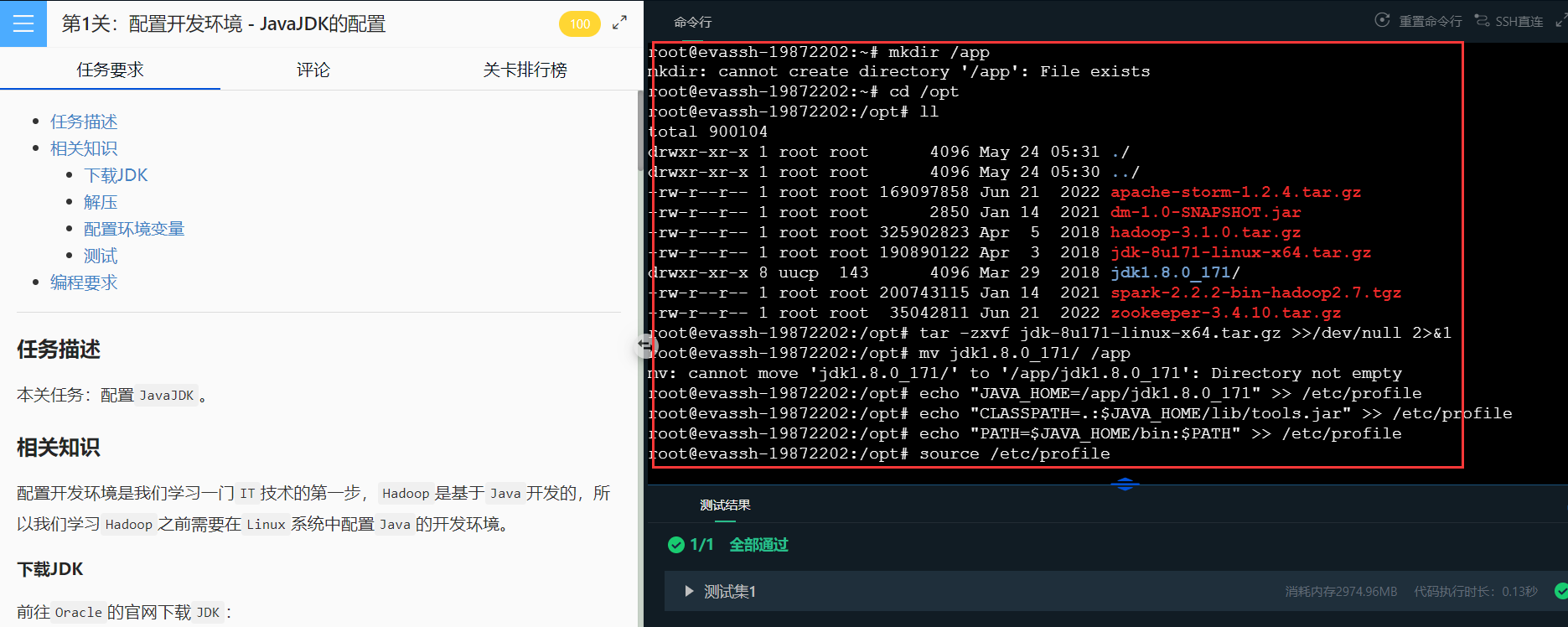

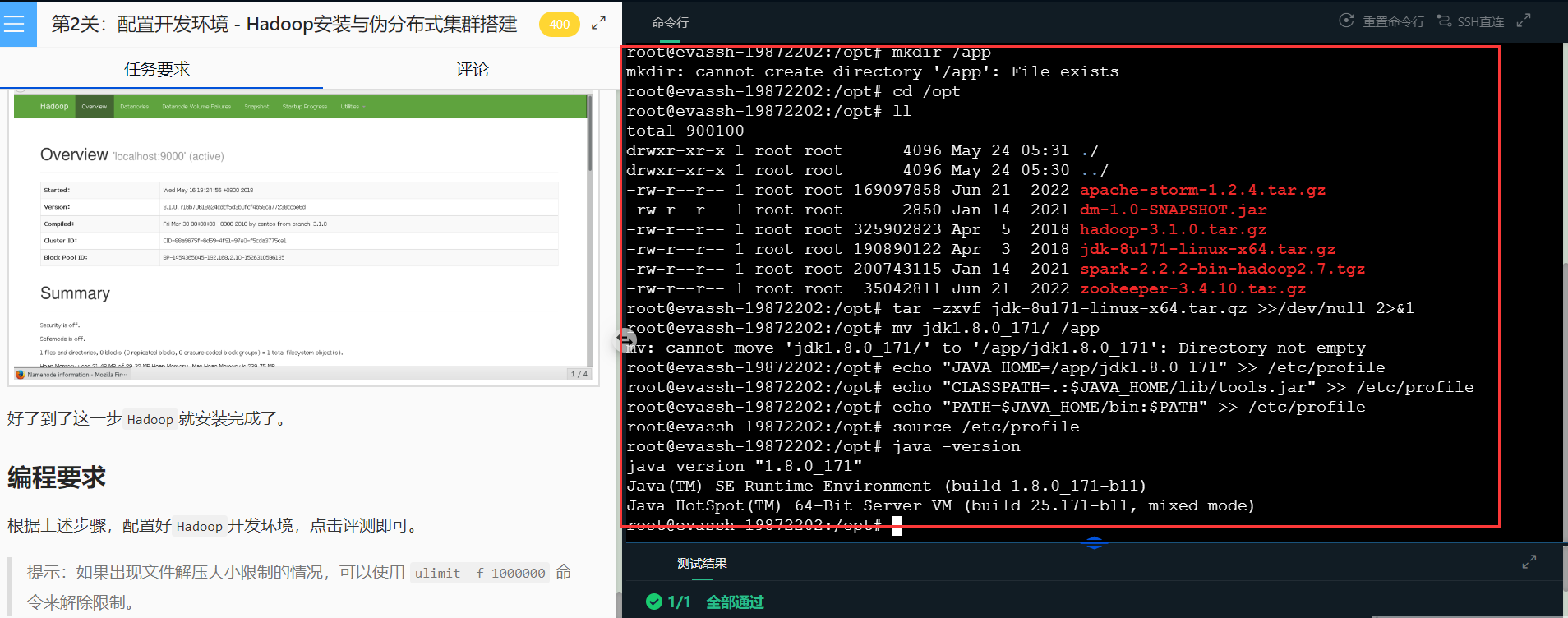

首先在右侧命令行中创建一个/app文件夹,我们之后的软件都将安装在该目录下。

命令:mkdir /app

然后,切换到/opt目录下,来查看一下提供的压缩包。

可以看到我们已经帮你下载好了JDK和Hadoop的安装文件。

现在我们解压JDK并将其移动到/app目录下。

tar -zxvf jdk-8u171-linux-x64.tar.gz

mv jdk1.8.0_171/ /app

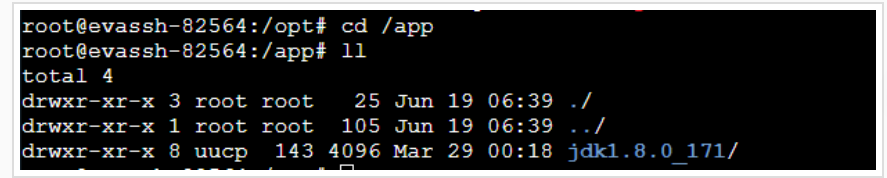

可以切换到/app目录下查看解压好的文件夹。

配置环境变量

解压好JDK之后还需要在环境变量中配置JDK,才可以使用,接下来就来配置JDK。

输入命令:vim /etc/profile 编辑配置文件;

在文件末尾输入如下代码(不可以有空格)。

然后,保存修改的配置文件。

保存方法:处于编辑模式下,先按 ESC 键,然后按 shift+: 之后,最后输入 wq 后,回车后就可以保存修改的配置文件。

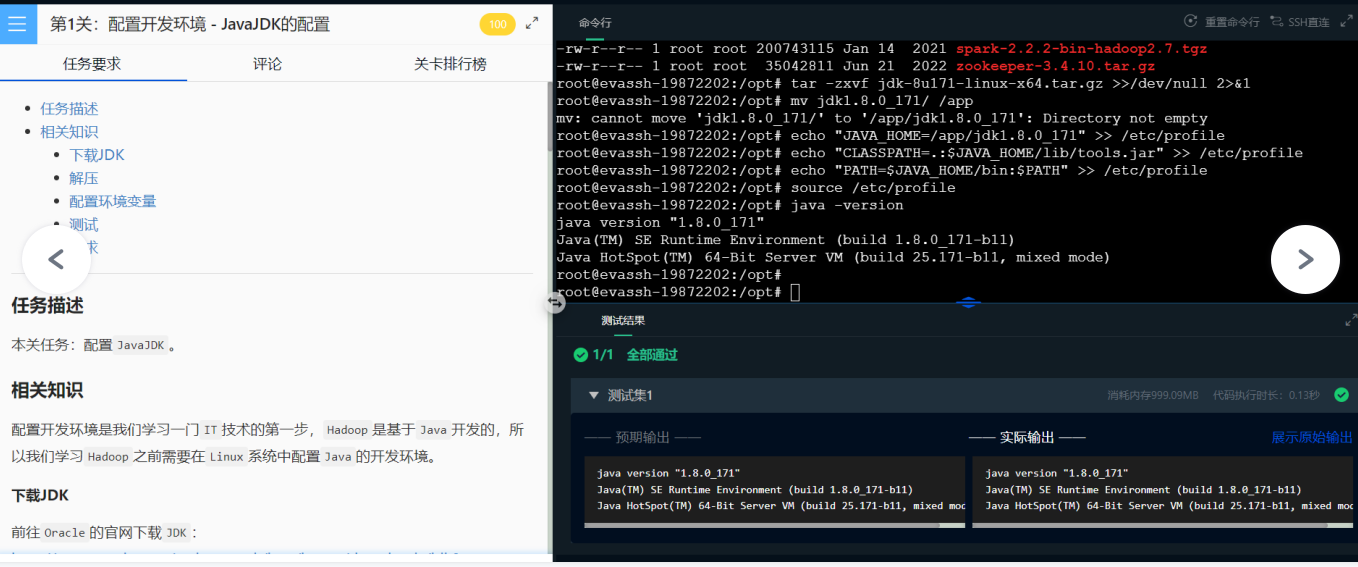

最后:source /etc/profile使刚刚的配置生效。

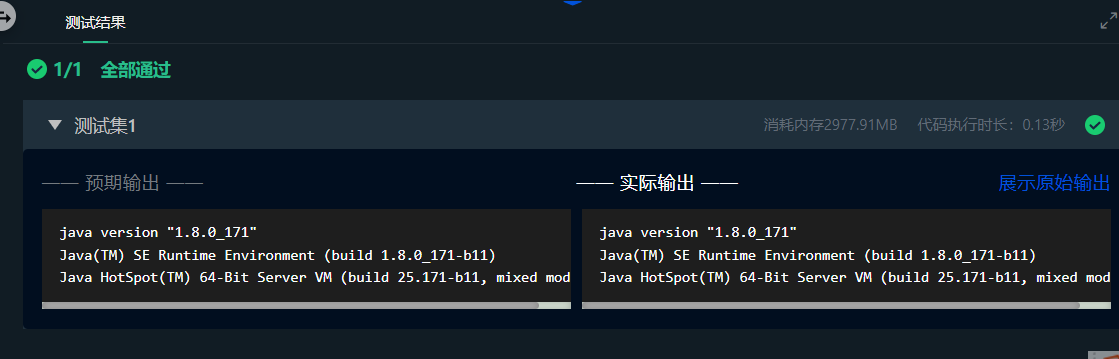

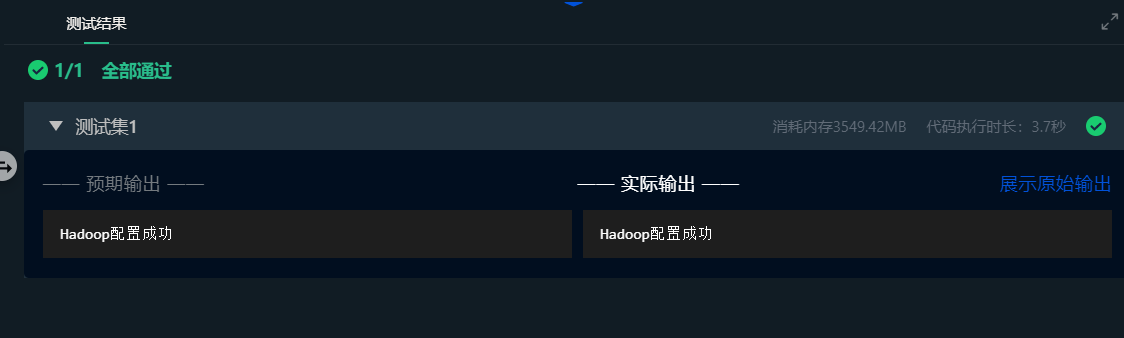

测试

最后我们可以测试一下环境变量是否配置成功。

输入:java -version 出现如下界面代表配置成功。

编程要求

根据上述步骤完成Java开发环境的配置即可。

注意:因为下次再开启实训,环境会重置,所以最好的方式是一次性通过所有关卡。

开始配置JDK吧,go on。

简单粗暴法:不想码字的小伙伴可以把下面的代码直接复制到命令行,配置就完成啦!!!

mkdir /app

cd /opt

ll

tar -zxvf jdk-8u171-linux-x64.tar.gz >>/dev/null 2>&1

mv jdk1.8.0_171/ /app

echo "JAVA_HOME=/app/jdk1.8.0_171" >> /etc/profile

echo "CLASSPATH=.:$JAVA_HOME/lib/tools.jar" >> /etc/profile

echo "PATH=$JAVA_HOME/bin:$PATH" >> /etc/profile

source /etc/profile

java -version

第二关

第2关:配置开发环境 - Hadoop安装与伪分布式集群搭建

任务描述

本关任务:安装配置Hadoop开发环境。

相关知识

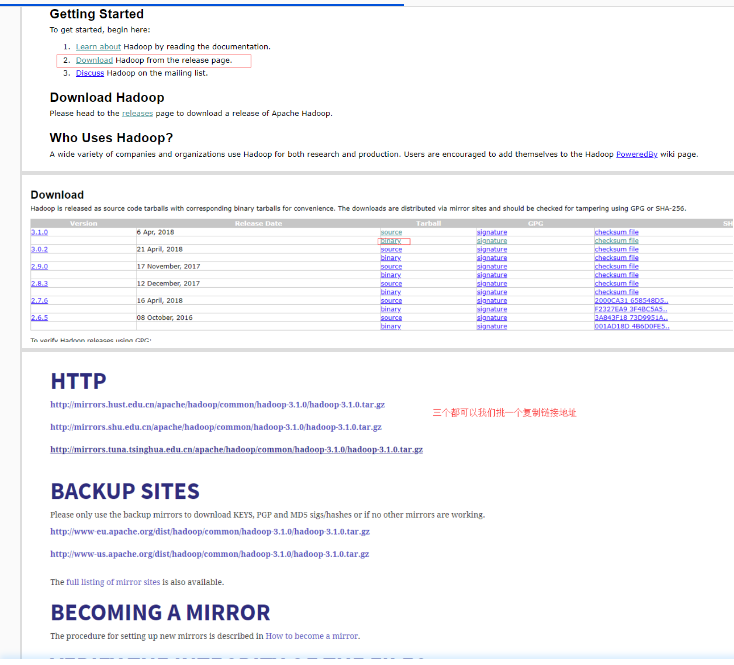

下载Hadoop

我们去官网下载:http://hadoop.apache.org/

在平台上已经帮你下载好了(在/opt目录下),这里只是展示一下下载步骤。

输入wget下载Hadoop;

wget http://mirrors.tuna.tsinghua.edu.cn/apache/hadoop/common/hadoop-2.7.7/hadoop-2.7.7.tar.gz

如果是生产环境就需要验证文件的完整性,在这里就偷个懒了。

由于解压包有大概300M,所以我们已经预先帮你下载好了,切换到/opt目录下即可看到。

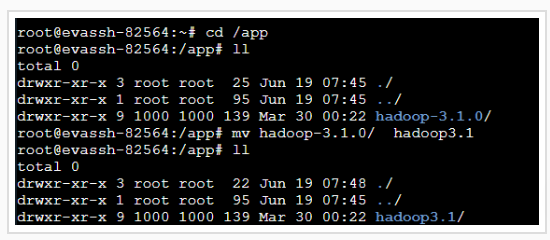

接下来解压Hadoop的压缩包,然后将解压好的文件移动到/app目录下。

我们来切换到app目录下修改一下hadoop文件夹的名字。

提示:如果出现文件解压大小限制的情况,可以使用 ulimit -f 1000000 命令来解除限制。

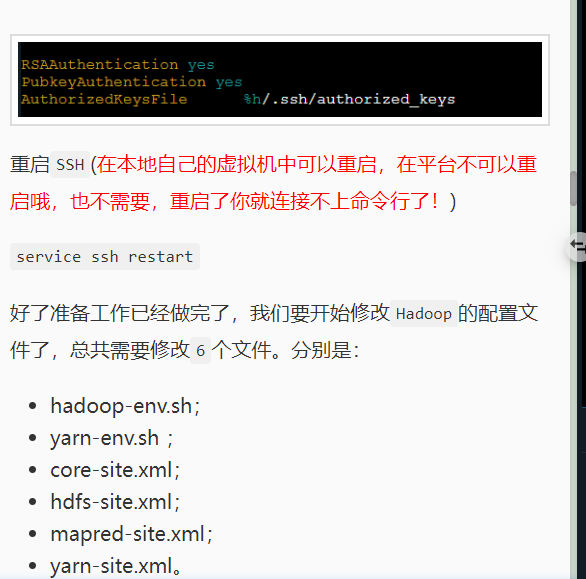

配置Hadoop环境

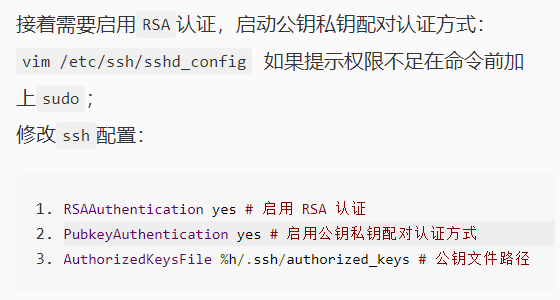

设置SSH免密登录

在之后操作集群的时候我们需要经常登录主机和从机,所以设置SSH免密登录时有必要的。

输入如下代码:

ssh-keygen -t rsa -P ''

生成无密码密钥对,询问保存路径直接输入回车,生成密钥对:id_rsa和id_rsa.pub,默认存储在~/.ssh目录下。

接下来:把id_rsa.pub追加到授权的key里面去。

cat ~/.ssh/id_rsa.pub >> ~/.ssh/authorized_keys

然后修改权限:chmod 600 ~/.ssh/authorized_keys

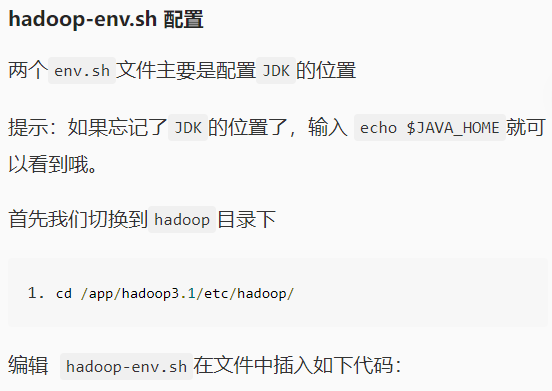

# The java implementation to use.

#export JAVA_HOME=${JAVA_HOME}

export JAVA_HOME=/app/jdk1.8.0_171

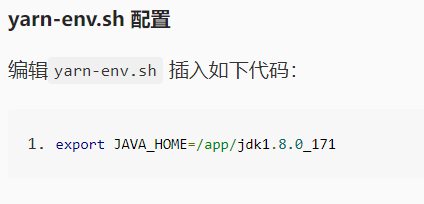

export JAVA_HOME=/app/jdk1.8.0_171

<configuration>

<property>

<name>fs.default.name</name>

<value>hdfs://localhost:9000</value>

<description>HDFS的URI,文件系统://namenode标识:端口号</description>

</property>

<property>

<name>hadoop.tmp.dir</name>

<value>/usr/hadoop/tmp</value>

<description>namenode上本地的hadoop临时文件夹</description>

</property>

</configuration>

<configuration>

<property>

<name>dfs.name.dir</name>

<value>/usr/hadoop/hdfs/name</value>

<description>namenode上存储hdfs名字空间元数据 </description>

</property>

<property>

<name>dfs.data.dir</name>

<value>/usr/hadoop/hdfs/data</value>

<description>datanode上数据块的物理存储位置</description>

</property>

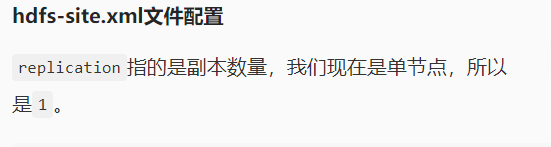

<property>

<name>dfs.replication</name>

<value>1</value>

</property>

</configuration>

mapred-site.xml文件配置

<configuration>

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

</configuration>

yarn-site.xml配置

<configuration>

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

<property>

<name>yarn.resourcemanager.webapp.address</name>

<value>192.168.2.10:8099</value>

<description>这个地址是mr管理界面的</description>

</property>

</configuration>

创建文件夹

我们在配置文件中配置了一些文件夹路径,现在我们来创建他们,在/usr/hadoop/目录下使用hadoop用户操作,建立tmp、hdfs/name、hdfs/data目录,执行如下命令:

mkdir -p /usr/hadoop/tmp

mkdir /usr/hadoop/hdfs

mkdir /usr/hadoop/hdfs/data

mkdir /usr/hadoop/hdfs/name

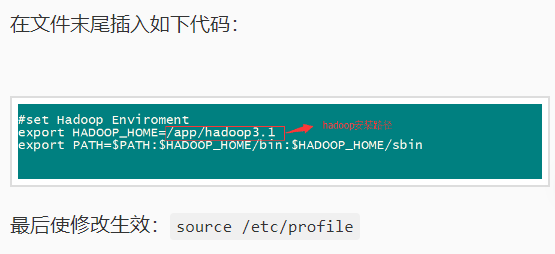

将Hadoop添加到环境变量中

vim /etc/profile

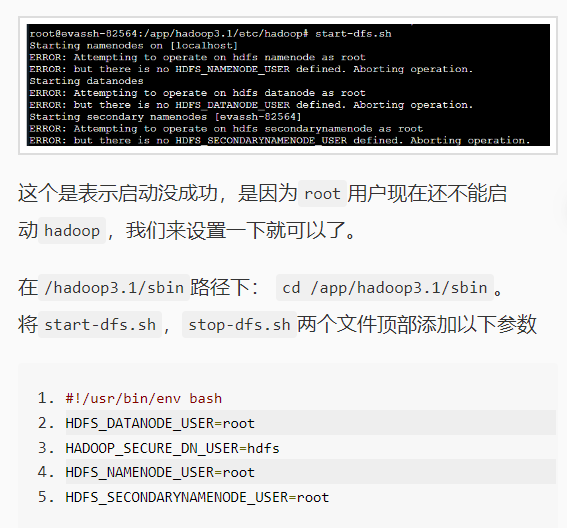

#!/usr/bin/env bash

HDFS_DATANODE_USER=root

HADOOP_SECURE_DN_USER=hdfs

HDFS_NAMENODE_USER=root

HDFS_SECONDARYNAMENODE_USER=root

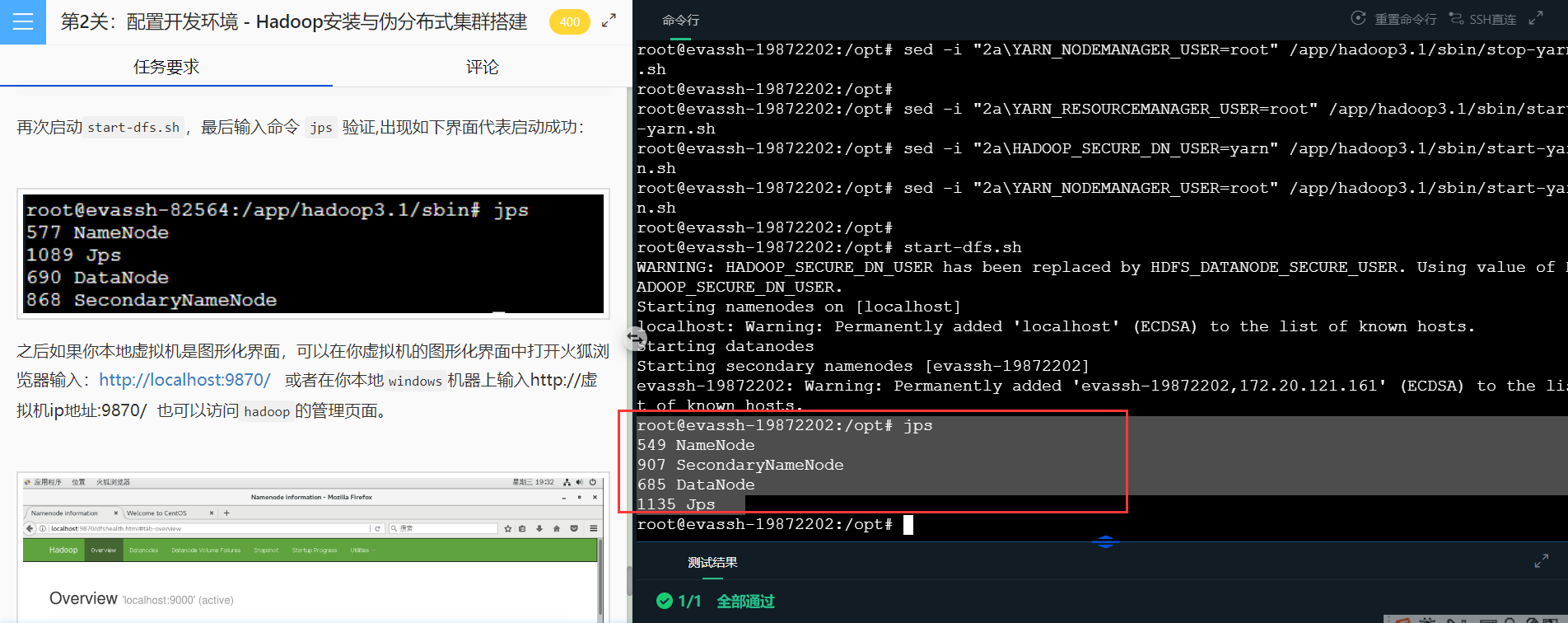

还有,start-yarn.sh,stop-yarn.sh顶部也需添加以下:

#!/usr/bin/env bash

YARN_RESOURCEMANAGER_USER=root

HADOOP_SECURE_DN_USER=yarn

YARN_NODEMANAGER_USER=root

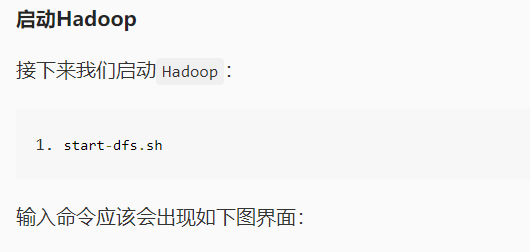

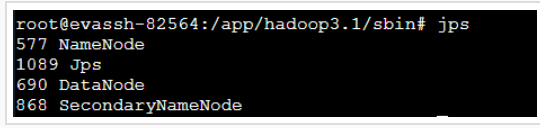

再次启动start-dfs.sh,最后输入命令 jps 验证,出现如下界面代表启动成功:

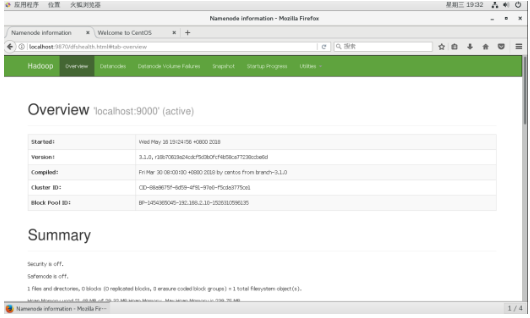

之后如果你本地虚拟机是图形化界面,可以在你虚拟机的图形化界面中打开火狐浏览器输入:http://localhost:9870/ 或者在你本地windows机器上输入http://虚拟机ip地址:9870/ 也可以访问hadoop的管理页面。

好了到了这一步Hadoop就安装完成了。

简单粗暴法:不想码字的小伙伴可以把下面的代码直接复制到命令行,配置就完成啦!!!

mkdir /app

cd /opt

ll

tar -zxvf jdk-8u171-linux-x64.tar.gz >>/dev/null 2>&1

mv jdk1.8.0_171/ /app

echo "JAVA_HOME=/app/jdk1.8.0_171" >> /etc/profile

echo "CLASSPATH=.:$JAVA_HOME/lib/tools.jar" >> /etc/profile

echo "PATH=$JAVA_HOME/bin:$PATH" >> /etc/profile

source /etc/profile

java -version

tar -zxvf /opt/hadoop-3.1.0.tar.gz -C /app >>/dev/null 2>&1

mv /app/hadoop-3.1.0 /app/hadoop3.1 2>/dev/null

ssh-keygen -t rsa -P '' <<< $'\n'

cat ~/.ssh/id_rsa.pub >> ~/.ssh/authorized_keys

chmod 600 ~/.ssh/authorized_keys

echo "AuthorizedKeysFile %h/.ssh/authorized_keys" >> /etc/ssh/sshd_config

echo "export JAVA_HOME=/app/jdk1.8.0_171" >> /app/hadoop3.1/etc/hadoop/hadoop-env.sh

echo "export JAVA_HOME=/app/jdk1.8.0_171" >> /app/hadoop3.1/etc/hadoop/yarn-env.sh

sed -i 's|</configuration>||g' /app/hadoop3.1/etc/hadoop/core-site.xml

sed -i 's/<configuration>//g' /app/hadoop3.1/etc/hadoop/core-site.xml

echo "<configuration>" >> /app/hadoop3.1/etc/hadoop/core-site.xml

echo "<property>" >> /app/hadoop3.1/etc/hadoop/core-site.xml

echo "<name>fs.default.name</name>" >> /app/hadoop3.1/etc/hadoop/core-site.xml

echo "<value>hdfs://localhost:9000</value>" >> /app/hadoop3.1/etc/hadoop/core-site.xml

echo "<description>HDFSURI://namenode</description>" >> /app/hadoop3.1/etc/hadoop/core-site.xml

echo "</property>" >> /app/hadoop3.1/etc/hadoop/core-site.xml

echo "<property>" >> /app/hadoop3.1/etc/hadoop/core-site.xml

echo "<name>hadoop.tmp.dir</name>" >> /app/hadoop3.1/etc/hadoop/core-site.xml

echo "<value>/usr/hadoop/tmp</value>" >> /app/hadoop3.1/etc/hadoop/core-site.xml

echo "<description>namenode</description>" >> /app/hadoop3.1/etc/hadoop/core-site.xml

echo "</property>" >> /app/hadoop3.1/etc/hadoop/core-site.xml

echo "</configuration>" >> /app/hadoop3.1/etc/hadoop/core-site.xml

sed -i 's|</configuration>||g' /app/hadoop3.1/etc/hadoop/hdfs-site.xml

sed -i 's/<configuration>//g' /app/hadoop3.1/etc/hadoop/hdfs-site.xml

echo "<configuration>" >> /app/hadoop3.1/etc/hadoop/hdfs-site.xml

echo "<property>" >> /app/hadoop3.1/etc/hadoop/hdfs-site.xml

echo "<name>dfs.name.dir</name>" >> /app/hadoop3.1/etc/hadoop/hdfs-site.xml

echo "<value>/usr/hadoop/hdfs/name</value>" >> /app/hadoop3.1/etc/hadoop/hdfs-site.xml

echo "<description>namenode</description>" >> /app/hadoop3.1/etc/hadoop/hdfs-site.xml

echo "</property>" >> /app/hadoop3.1/etc/hadoop/hdfs-site.xml

echo "<property>" >> /app/hadoop3.1/etc/hadoop/hdfs-site.xml

echo "<name>dfs.data.dir</name>" >> /app/hadoop3.1/etc/hadoop/hdfs-site.xml

echo "<value>/usr/hadoop/hdfs/data</value>" >> /app/hadoop3.1/etc/hadoop/hdfs-site.xml

echo "<description>datanode</description>" >> /app/hadoop3.1/etc/hadoop/hdfs-site.xml

echo "</property>" >> /app/hadoop3.1/etc/hadoop/hdfs-site.xml

echo "" >> /app/hadoop3.1/etc/hadoop/hdfs-site.xml

echo "<property>" >> /app/hadoop3.1/etc/hadoop/hdfs-site.xml

echo "<name>dfs.replication</name>" >> /app/hadoop3.1/etc/hadoop/hdfs-site.xml

echo "<value>1</value>" >> /app/hadoop3.1/etc/hadoop/hdfs-site.xml

echo "</property>" >> /app/hadoop3.1/etc/hadoop/hdfs-site.xml

echo "</configuration>" >> /app/hadoop3.1/etc/hadoop/hdfs-site.xml

sed -i 's|</configuration>||g' /app/hadoop3.1/etc/hadoop/mapred-site.xml

sed -i 's/<configuration>//g' /app/hadoop3.1/etc/hadoop/mapred-site.xml

echo "<configuration>" >> /app/hadoop3.1/etc/hadoop/mapred-site.xml

echo "<property>" >> /app/hadoop3.1/etc/hadoop/mapred-site.xml

echo "<name>mapreduce.framework.name</name>" >> /app/hadoop3.1/etc/hadoop/mapred-site.xml

echo "<value>yarn</value>" >> /app/hadoop3.1/etc/hadoop/mapred-site.xml

echo "</property>" >> /app/hadoop3.1/etc/hadoop/mapred-site.xml

echo "</configuration>" >> /app/hadoop3.1/etc/hadoop/mapred-site.xml

sed -i 's|</configuration>||g' /app/hadoop3.1/etc/hadoop/yarn-site.xml

sed -i 's/<configuration>//g' /app/hadoop3.1/etc/hadoop/yarn-site.xml

echo "<configuration>" >> /app/hadoop3.1/etc/hadoop/yarn-site.xml

echo "<property>" >> /app/hadoop3.1/etc/hadoop/yarn-site.xml

echo "<name>yarn.nodemanager.aux-services</name>" >> /app/hadoop3.1/etc/hadoop/yarn-site.xml

echo "<value>mapreduce_shuffle</value>" >> /app/hadoop3.1/etc/hadoop/yarn-site.xml

echo "</property>" >> /app/hadoop3.1/etc/hadoop/yarn-site.xml

echo "<property>" >> /app/hadoop3.1/etc/hadoop/yarn-site.xml

echo "<name>yarn.resourcemanager.webapp.address</name>" >> /app/hadoop3.1/etc/hadoop/yarn-site.xml

echo "<value>192.168.2.10:8099</value>">> /app/hadoop3.1/etc/hadoop/yarn-site.xml

echo "<description></description>" >> /app/hadoop3.1/etc/hadoop/yarn-site.xml

echo "</property>" >> /app/hadoop3.1/etc/hadoop/yarn-site.xml

echo "</configuration>" >> /app/hadoop3.1/etc/hadoop/yarn-site.xml

mkdir -p /usr/hadoop/tmp

mkdir /usr/hadoop/hdfs

mkdir /usr/hadoop/hdfs/data

mkdir /usr/hadoop/hdfs/name

echo "export HADOOP_HOME=/app/hadoop3.1" >> /etc/profile

echo "export PATH=\$PATH:\$HADOOP_HOME/bin:\$HADOOP_HOME/sbin" >> /etc/profile

source /etc/profile

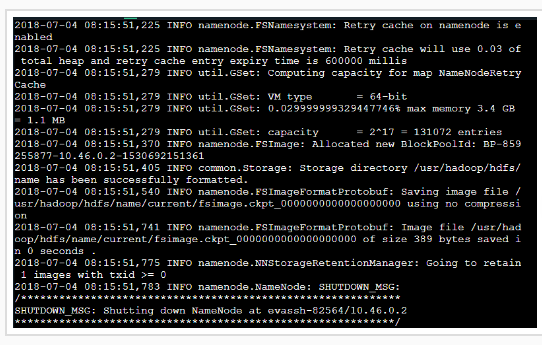

hadoop namenode -format

start-yarn.sh

sed -i "2a\HDFS_DATANODE_USER=root" /app/hadoop3.1/sbin/start-dfs.sh

sed -i "2a\HADOOP_SECURE_DN_USER=hdfs" /app/hadoop3.1/sbin/start-dfs.sh

sed -i "2a\HDFS_NAMENODE_USER=root" /app/hadoop3.1/sbin/start-dfs.sh

sed -i "2a\HDFS_SECONDARYNAMENODE_USER=root" /app/hadoop3.1/sbin/start-dfs.sh

sed -i "2a\HDFS_DATANODE_USER=root" /app/hadoop3.1/sbin/stop-dfs.sh

sed -i "2a\HADOOP_SECURE_DN_USER=hdfs" /app/hadoop3.1/sbin/stop-dfs.sh

sed -i "2a\HDFS_NAMENODE_USER=root" /app/hadoop3.1/sbin/stop-dfs.sh

sed -i "2a\HDFS_SECONDARYNAMENODE_USER=root" /app/hadoop3.1/sbin/stop-dfs.sh

sed -i "2a\YARN_RESOURCEMANAGER_USER=root" /app/hadoop3.1/sbin/stop-yarn.sh

sed -i "2a\HADOOP_SECURE_DN_USER=yarn" /app/hadoop3.1/sbin/stop-yarn.sh

sed -i "2a\YARN_NODEMANAGER_USER=root" /app/hadoop3.1/sbin/stop-yarn.sh

sed -i "2a\YARN_RESOURCEMANAGER_USER=root" /app/hadoop3.1/sbin/start-yarn.sh

sed -i "2a\HADOOP_SECURE_DN_USER=yarn" /app/hadoop3.1/sbin/start-yarn.sh

sed -i "2a\YARN_NODEMANAGER_USER=root" /app/hadoop3.1/sbin/start-yarn.sh

start-dfs.sh

jps

如果还是有不明白的小伙伴欢迎评论区留言!!!

智能推荐

软件测试流程包括哪些内容?测试方法有哪些?_测试过程管理中包含哪些过程-程序员宅基地

文章浏览阅读2.9k次,点赞8次,收藏14次。测试主要做什么?这完全都体现在测试流程中,同时测试流程是面试问题中出现频率最高的,这不仅是因为测试流程很重要,而是在面试过程中这短短的半小时到一个小时的时间,通过测试流程就可以判断出应聘者是否合适,故在测试流程中包含了测试工作的核心内容,例如需求分析,测试用例的设计,测试执行,缺陷等重要的过程。..._测试过程管理中包含哪些过程

政府数字化政务的人工智能与机器学习应用:如何提高政府工作效率-程序员宅基地

文章浏览阅读870次,点赞16次,收藏19次。1.背景介绍政府数字化政务是指政府利用数字技术、互联网、大数据、人工智能等新技术手段,对政府政务进行数字化改革,提高政府工作效率,提升政府服务质量的过程。随着人工智能(AI)和机器学习(ML)技术的快速发展,政府数字化政务中的人工智能与机器学习应用也逐渐成为政府改革的重要内容。政府数字化政务的人工智能与机器学习应用涉及多个领域,包括政策决策、政府服务、公共安全、社会治理等。在这些领域,人工...

ssm+mysql+微信小程序考研刷题平台_mysql刷题软件-程序员宅基地

文章浏览阅读219次,点赞2次,收藏4次。系统主要的用户为用户、管理员,他们的具体权限如下:用户:用户登录后可以对管理员上传的学习视频进行学习。用户可以选择题型进行练习。用户选择小程序提供的考研科目进行相关训练。用户可以进行水平测试,并且查看相关成绩用户可以进行错题集的整理管理员:管理员登录后可管理个人基本信息管理员登录后可管理个人基本信息管理员可以上传、发布考研的相关例题及其分析,并对题型进行管理管理员可以进行查看、搜索考研题目及错题情况。_mysql刷题软件

根据java代码描绘uml类图_Myeclipse8.5下JAVA代码导成UML类图-程序员宅基地

文章浏览阅读1.4k次。myelipse里有UML1和UML2两种方式,UML2功能更强大,但是两者生成过程差别不大1.建立Test工程,如下图,uml包存放uml类图package com.zz.domain;public class User {private int id;private String name;public int getId() {return id;}public void setId(int..._根据以下java代码画出类图

Flume自定义拦截器-程序员宅基地

文章浏览阅读174次。需求:一个topic包含很多个表信息,需要自动根据json字符串中的字段来写入到hive不同的表对应的路径中。发送到Kafka中的数据原本最外层原本没有pkDay和project,只有data和name。因为担心data里面会空值,所以根同事商量,让他们在最外层添加了project和pkDay字段。pkDay字段用于表的自动分区,proejct和name合起来用于自动拼接hive表的名称为 ..._flume拦截器自定义开发 kafka

java同时输入不同类型数据,Java Spring中同时访问多种不同数据库-程序员宅基地

文章浏览阅读380次。原标题:Java Spring中同时访问多种不同数据库 多样的工作要求,可以使用不同的工作方法,只要能获得结果,就不会徒劳。开发企业应用时我们常常遇到要同时访问多种不同数据库的问题,有时是必须把数据归档到某种数据仓库中,有时是要把数据变更推送到第三方数据库中。使用Spring框架时,使用单一数据库是非常容易的,但如果要同时访问多个数据库的话事件就变得复杂多了。本文以在Spring框架下开发一个Sp..._根据输入的不同连接不同的数据库

随便推点

EFT试验复位案例分析_eft电路图-程序员宅基地

文章浏览阅读3.6k次,点赞9次,收藏25次。本案例描述了晶振屏蔽以及开关电源变压器屏蔽对系统稳定工作的影响, 硬件设计时应考虑。_eft电路图

MR21更改价格_mr21 对于物料 zba89121 存在一个当前或未来标准价格-程序员宅基地

文章浏览阅读1.1k次。对于物料价格的更改,可以采取不同的手段:首先,我们来介绍MR21的方式。 需要说明的是,如果要对某一产品进行价格修改,必须满足的前提条件是: ■ 1、必须对价格生效的物料期间与对应会计期间进行开启; ■ 2、该产品在该物料期间未发生物料移动。执行MR21,例如更改物料1180051689的价格为20000元,系统提示“对于物料1180051689 存在一个当前或未来标准价格”,这是因为已经对该..._mr21 对于物料 zba89121 存在一个当前或未来标准价格

联想启天m420刷bios_联想启天M420台式机怎么装win7系统(完美解决usb)-程序员宅基地

文章浏览阅读7.4k次,点赞3次,收藏13次。[文章导读]联想启天M420是一款商用台式电脑,预装的是win10系统,用户还是喜欢win7系统,该台式机采用的intel 8代i5 8500CPU,在安装安装win7时有很多问题,在安装win7时要在BIOS中“关闭安全启动”和“开启兼容模式”,并且安装过程中usb不能使用,要采用联想win7新机型安装,且默认采用的uefi+gpt模式,要改成legacy+mbr引导,那么联想启天M420台式电..._启天m420刷bios

冗余数据一致性,到底如何保证?-程序员宅基地

文章浏览阅读2.7k次,点赞2次,收藏9次。一,为什么要冗余数据互联网数据量很大的业务场景,往往数据库需要进行水平切分来降低单库数据量。水平切分会有一个patition key,通过patition key的查询能..._保证冗余性

java 打包插件-程序员宅基地

文章浏览阅读88次。是时候闭环Java应用了 原创 2016-08-16 张开涛 你曾经因为部署/上线而痛苦吗?你曾经因为要去运维那改配置而烦恼吗?在我接触过的一些部署/上线方式中,曾碰到过以下一些问题:1、程序代码和依赖都是人工上传到服务器,不是通过工具进行部署和发布;2、目录结构没有规范,jar启动时通过-classpath任意指定;3、fat jar,把程序代码、配置文件和依赖jar都打包到一个jar中,改配置..._那么需要把上面的defaultjavatyperesolver类打包到插件中

VS2015,Microsoft Visual Studio 2005,SourceInsight4.0使用经验,Visual AssistX番茄助手的安装与基本使用9_番茄助手颜色-程序员宅基地

文章浏览阅读909次。1.得下载一个番茄插件,按alt+g才可以有函数跳转功能。2.不安装番茄插件,按F12也可以有跳转功能。3.进公司的VS工程是D:\sync\build\win路径,.sln才是打开工程的方式,一个是VS2005打开的,一个是VS2013打开的。4.公司库里的线程接口,在CmThreadManager.h 里,这个里面是我们的线程库,可以直接拿来用。CreateUserTaskThre..._番茄助手颜色